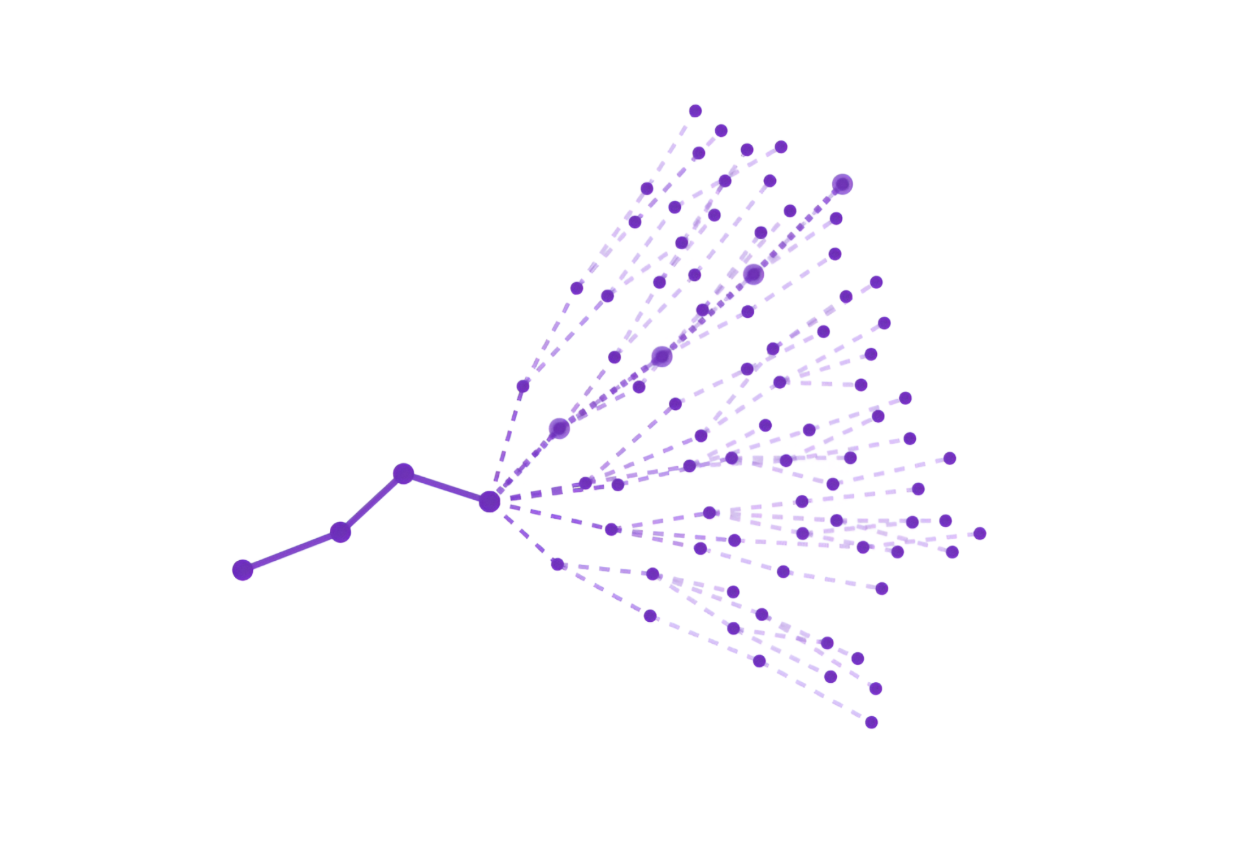

Ergebnisse

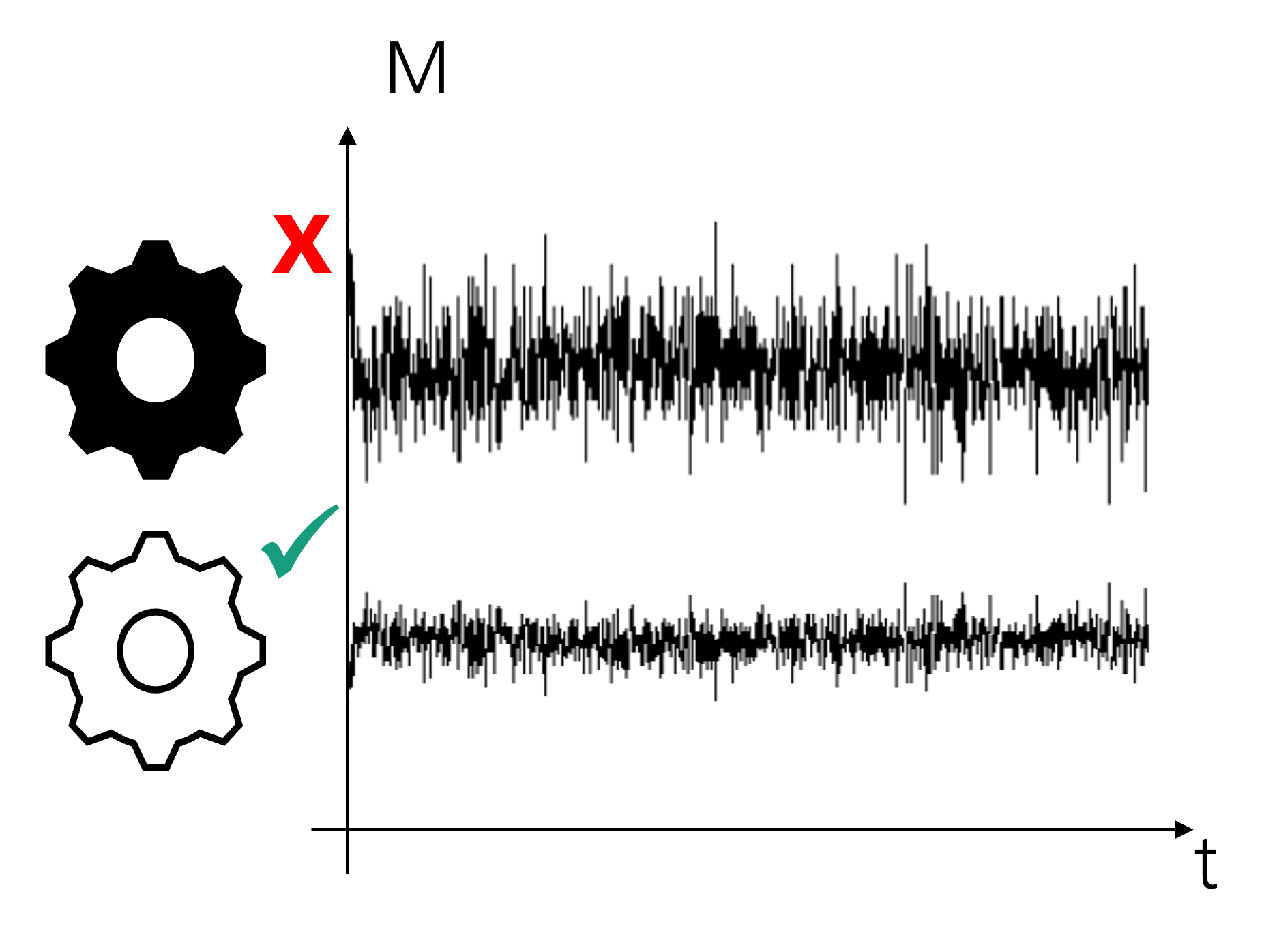

Bauteile werden bis zum Materialversagen geprüft. Eine KI prognostiziert basierend auf den Ergebnissen der ersten Testzyklen, wie lange ein Bauteil halten wird. Da das KI-System keinen Einfluss auf die Sicherheit von Personen hat, sondern lediglich zur Qualitätssicherung dient, handelt es sich nicht um ein Hochrisiko-KI-System.

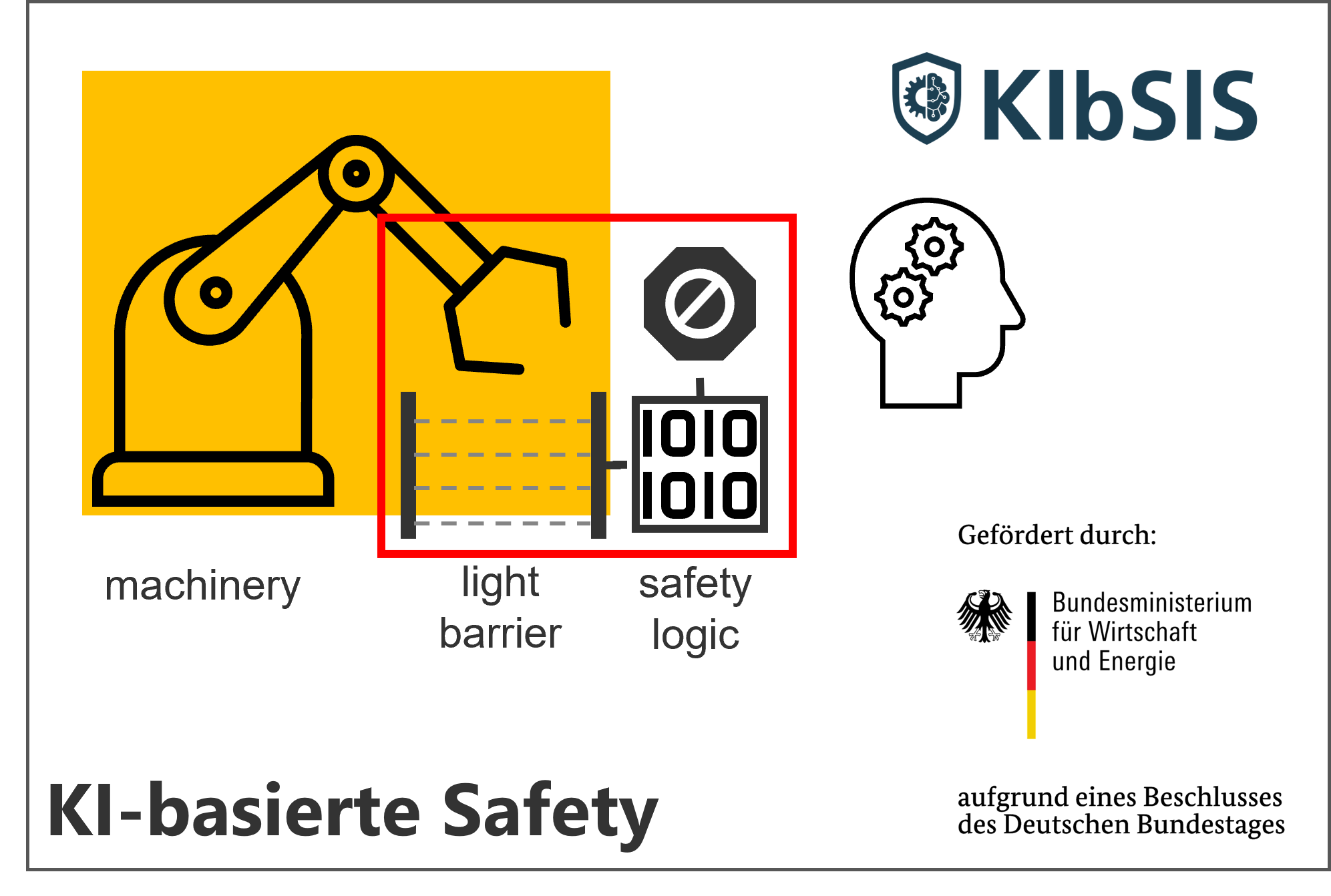

In diesem Legal Quick Check wird ein KI-System zur Quittierung von Safety-Einrichtungen anhand von Video-Daten geprüft. Da das System dazu ausgelegt ist, Menschen zu erkennen und darauf basierend Entscheidungen im Anlagenbetrieb vorgenommen werden, liegt hier ein Hochrisiko-KI-System nach AI Act und Maschinenverordnung vor.

In diesem Legal Quick Check wurde ein KI-Modell zur Bewertung von Kreditrisiken untersucht. Da es sich dabei um Zugänglichkeit und Inanspruchnahme grundlegender privater und grundlegender öffentlicher Dienste und Leistungen handelt, ist das KI-System als Hochrisiko-KI einzustufen.

Es geht um eine Softwareplattform, die es industriellen Anwendern ermöglicht, eigene KI-Modelle zu erstellen, zu trainieren und produktiv einzusetzen. Da keine vortrainierten Modelle über die Plattform bereitgestellt werden und kein direkter Einfluss auf eine Maschine besteht, fällt die Plattform selbst nicht unter AI Act oder MVO.

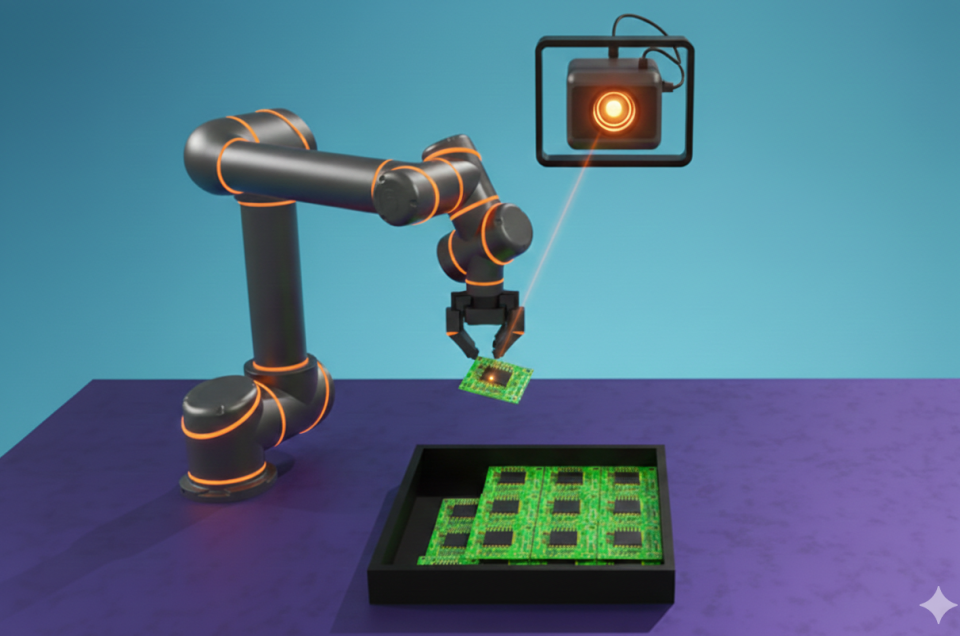

In diesem Legal Quick Check Light wird die KI-basierte optische Prüfung eines Medizinprodukts (Injektionsnadel) mittels Anomaliedetektion betrachtet. Es handelt sich hierbei um ein KI-System mit niedrigem Risiko.

Das KI-System überwacht den Normalbetrieb eines autonomen Fahrzeugs und erkennt Anomalien / Abweichungen im Betrieb. Da die KI nur diagnostisch eingesetzt wird, handelt es sich nicht um eine riskante Anwendung.

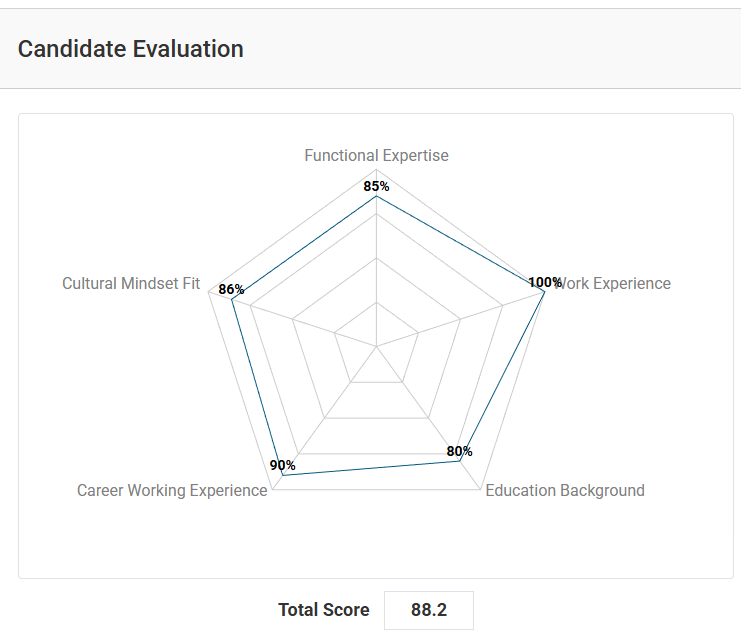

In diesem Legal Quick Check wurde eine Plattform untersucht, die Unternehmen KI-basiert bei Recrutingprozessen unterstützt. Da die KI Profiling natürlicher Personen vornimmt, handelt es sich um ein Hochrisiko-KI-System.

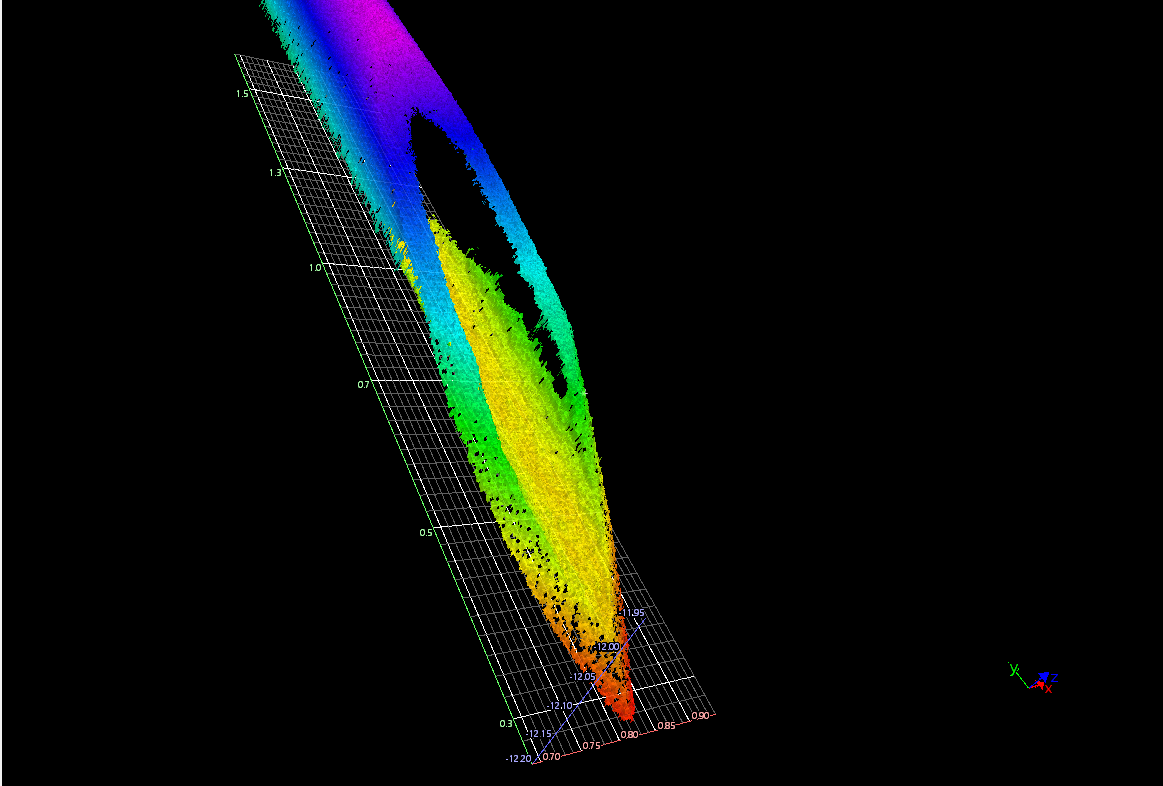

In diesem Legal Quick Check wurde ein KI-System zur Auswertung von Radardaten geprüft. Da das System dazu ausgelegt ist, Menschen zu detektieren und darauf basierend sicherheitsrelevante Entscheidungen in Robotern getroffen werden, liegt ein Hochrisiko-KI-System nach AI Act und Maschinenverordnung vor.

Im Legal Quick Check wurde eine Software für Personalmanagement untersucht. Das integrierte KI-System rankt mögliche Projektmitarbeiter aus einer Datenbank und unterstützt so bei der Personaleinsatzplanung. Da die Vorschläge der KI menschliche Entscheidungen maßgeblich leiten, handelt es sich um ein Hochrisiko-KI-System.

Es wurde ein virtueller Experte untersucht, der dem Nutzer Fragen zur Produktionsanlage beantwortet, z.B. für Wartungstätigkeiten. Es handelt sich nicht um ein Hochrisikosystem. Dennoch sollte die Zuverlässigkeit der Ausgaben überprüft werden.

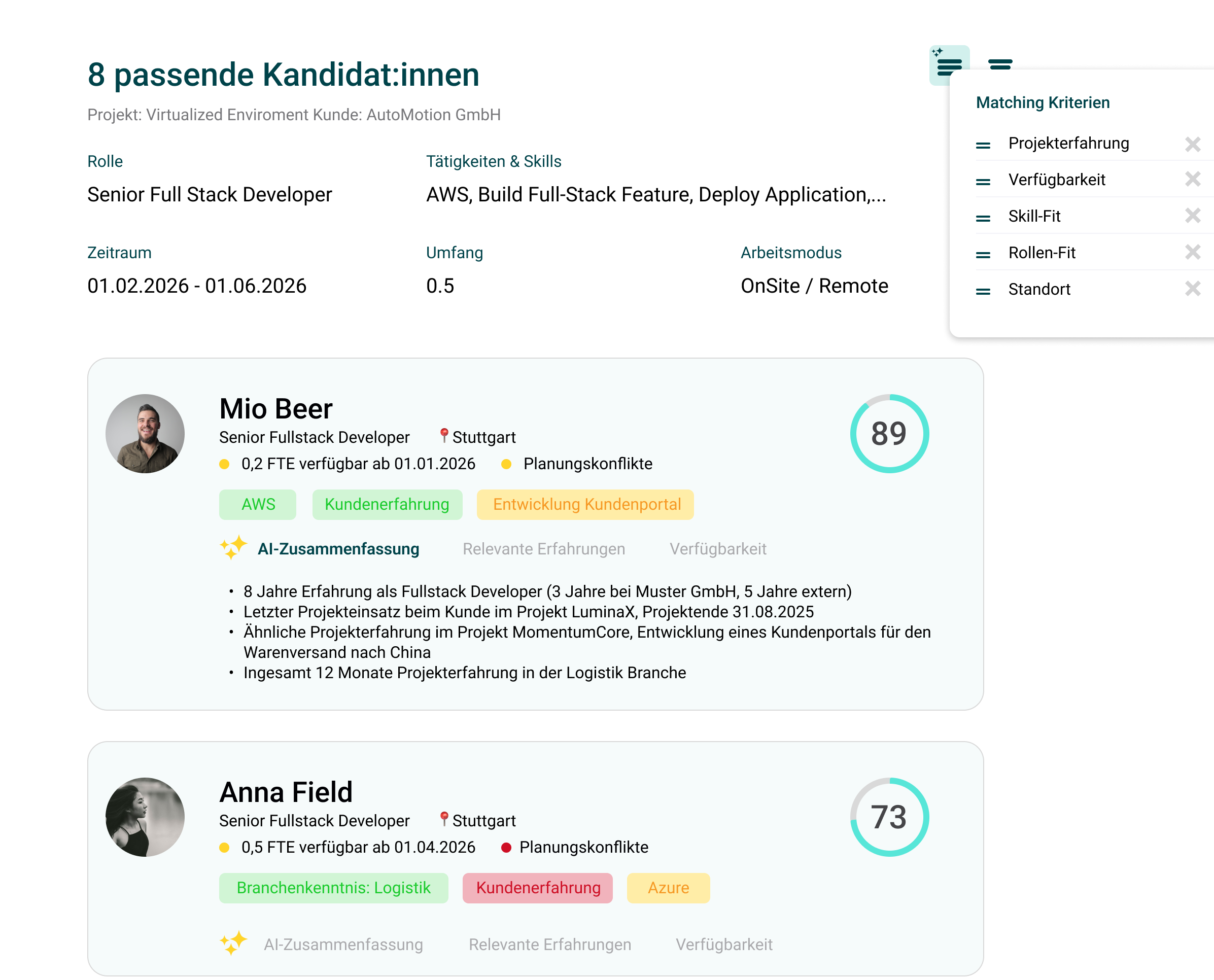

In diesem Legal Quick Check wurde ein KI-System zur Dokumentation von Operationen geprüft. Dazu verwendet das System als wichtigste Komponenten Speech-to-Text und Intent-Interpretation. Da die Dokumentation vor der Übertragung ins Klinik-Informationssystem von Medizinern geprüft wird, handelt es sich um ein nicht riskantes KI-System.

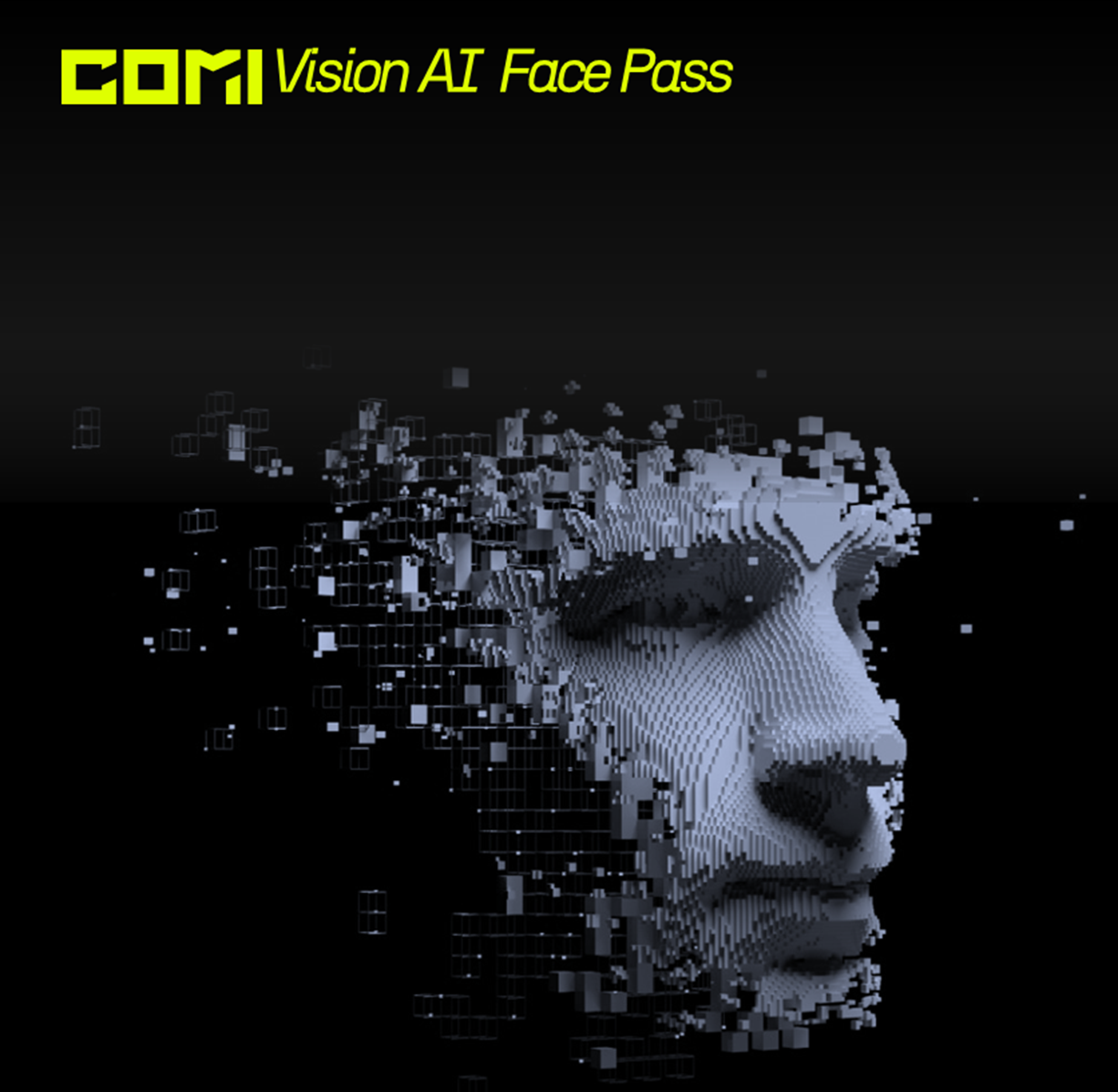

In diesem Legal Quick Check wurde ein KI-System untersucht, das zur biometrischen Identifikation an nicht-öffentlichen Zutrittspunkten eingesetzt wird. Aufgrund des Vorgehens beim Abgleich mit der Referenzdatenbank handelt es sich um ein Hochrisiko-KI-System.

In diesem Legal Quick Check wurde KI verwendet, um humanoide Roboter sicherer zu machen. Dabei wird erkannt, wie riskant die aktuelle Situation ist und wie sich der humanoide Roboter sicher verhalten kann. Da die KI direkt in die Sicherheitssteuerung des Roboters eingreift, gilt dieses System als Hochrisiko-KI-System.

In diesem Legal Quick Check wurde eine Open-Source-Bibliothek für Reinforcement Learning untersucht, die in unterschiedlichen Szenarien einsetzbar ist, wenn sequenzielle Entscheidungen getroffen werden müssen. Obwohl die Bibliothek genutzt werden kann, um KI-Systeme mit hohem Risiko zu trainieren, gehört sie selbst nicht zu den Hochrisiko-Anwendungen.

In diesem Legal Quick Check wurde ein KI-System zur Auswertung von Radardaten geprüft. Da das System dazu ausgelegt ist, Menschen von anderen mobilen Objekten im Erkennungsbereich zu unterscheiden und darauf basierend die Arbeitsgeschwindigkeit eines Roboters zu verlangsamen, liegt hier ein Hochrisiko-KI-System nach AI Act und Maschinenverordnung vor.

Reallabor für rechtskonforme KI und Robotik

Reallabor für rechtskonforme KI und Robotik